【Vive Pro Eye】Unityで視線追跡を公式SDKを使って実行してみる。

さあ、まだまだ開発頑張っていきましょう(/・ω・)/オー!

前回はViveProEyeの接続とSteam・Viveportのセットアップ、

視線追跡を行うためのVive公式のSDKをインストールするところまで行いました。umehashi.hatenablog.com

今回はインストールしたSDKをUnityに実際に入れて、サンプルシーンで視線追跡を体験してみましょう!(=゚ω゚)ノ

やっとUnity…に取り掛かる前に

前回の下準備の続きがあったりします(。-`ω-)zzz

①steamVRの設定

SteamVRを立ち上げまして『設定』を開き、VIVEPORTとカメラONにしておきましょう。自分はOculusからの転校生なので、念のためvive仕様として変更したのですが、必須ではないかもしれません。。。。

②視線追跡の許可とキャリブレーション(調整)

まずは前回の最後でインストールした、SR_Runtimeを実行します。視線追跡が可能になります。タスクバーで起動できているか確認しましょう。

次に、ヘッドマウントをつけ、コントローラの一番手前のボタンを押して、steamホームを開きます。下の方にViveProという選択肢があるので選択。

初回は視線追跡に同意を求められますのでOKを選択(写真撮り忘れたので説明書の7ページ見てください)次回以降はこのようにキャリブレーションを行うとなりますので、起動時やプレイヤー交代時には行うようにしましょう。

私はここで「精度すげえ!」と感動したので、ぜひこのタイミングで実行して、ぜひ共感してください('ω')

さて、UnityにSDKを入れるにあたって、前回インストールしたファイルの中身を見てみましょう。

取り扱い説明書的な…? なお、やっぱり英語(;´・ω・)

中を読んだ感じ、注意するべきポイントはこのあたりかなと思います。

・Windows 8.1 or later (64-bit)

・Unity 2017.4.17 or later

そういえば最近、Unityのバージョンが、1週間ごとに更新されてる気がするんですけど、なんなんでしょうね…?(´・ω・)

(それよりBlenderが使いやすくなったと聞いてそっちも気になる)

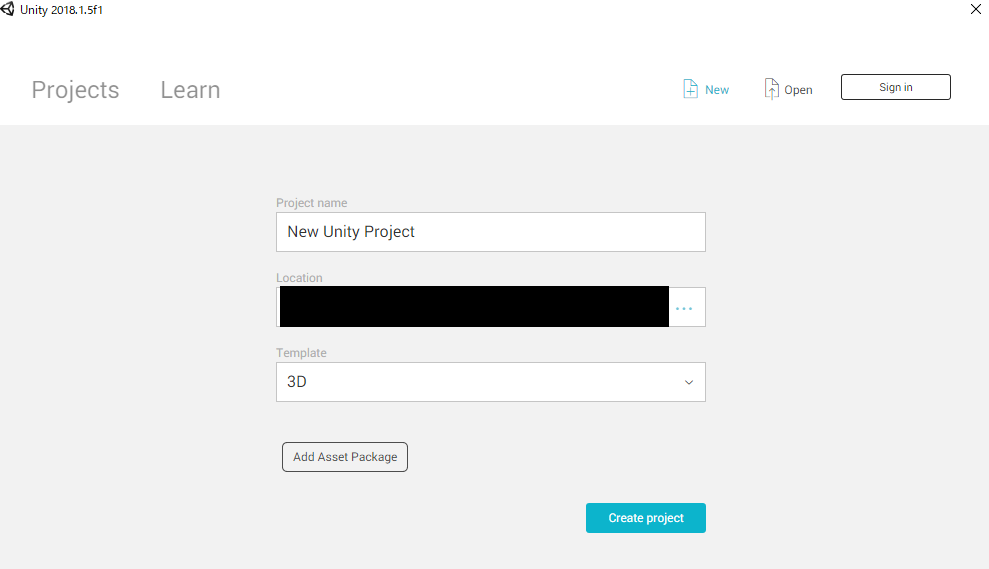

ちなみに私は、自分が勝手に信頼を寄せているバージョン2018.1.5fを使っています(*'ω'*)

準備完了!新規プロジェクトいきまーす!

長い準備も終わり、いざUnityへ(゚∀゚)

Unityで新規プロジェクトを3Dで作って…

Edit>Project Setting>Player と進んでXR SettingをONにしておきましょう。

そしたら遂に!

Assets>Import Package>Costom Packageで、SRanipal_SDK_1.0.1.0_Eye内のunitypackageをインポートしましょう。

Assetsに『ViveSR』フォルダができていれば成功です。 そしてViveSRの中のScenesの中のEyeSampleを開きます。

そして実行すると…

なんだこのおっさん!?

これ…鏡になっていますので、私です(; ・`д・´)

眼が常に自分の動かした通りに動きます…科学の力ってスゲー

黒目が動くのはもちろん、半目やウインクも、綺麗に反映されてました。

これはVtuberさんが取り入れるに違いない(゚∀゚)(リップトラッキングも出来るし)

左右と後方には、1m・3m・5m離れた的があり、見ている箇所が光ることが確認できました。

と、いうことで公式のデモを動かすことには、とりあえず成功しました(´・ω・)

計測された視線はどんなデータなのか…2次元?3次元?

ここからは、プログラムの中身を覗かないと分からない領域に突入しちゃいますね( ˘•ω•˘ )

【追記】

この先のチュートリアルもどきを作ってみました。

次回は視線追跡技術として採用されている、Tobii社が提供しているSDKを試した記事となります。

…開発者の方がいらっしゃいましたら、情報共有させていただければ幸いです。